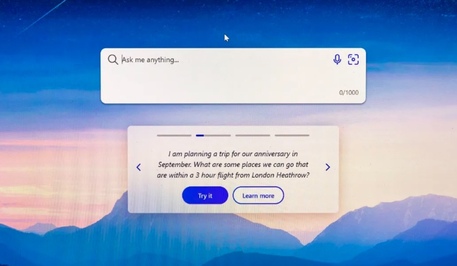

Microsoft ha limitato il numero di chat che gli utenti possono intrattenere con il nuovo Bing Search, il suo motore di ricerca basato su ChatGpt. I tester del servizio, che sfrutta il famoso chatbot AI che risponde, con linguaggio naturale, ai quesiti posti, hanno l'opportunità di ottenere solo cinque risposte alla volta da Bing, per un massimo di 50 al giorno. Fino a tale decisione, ognuno poteva passare ore a chiedere ciò che voleva alla piattaforma di prova. Una possibilità che, per ammissione della stessa Microsoft, alla lunga poteva portare l'algoritmo a sviare i discorsi, approcciando in maniera poco equilibrata le discussioni con gli esseri umani. Ad esempio, il giornalista Kevin Roose del New York Times afferma di aver provato per diversi giorni Bing AI, arrivandolo a definire un "adolescente lunatico e maniaco-depressivo".

Nel corso del suo test, Bing AI aveva cercato di convincere il giornalista a lasciare la moglie, per via di un matrimonio che, secondo l'intelligenza artificiale, era infelice. Microsoft ha spiegato che il progetto, essendo ancora in una fase primordiale, deve imparare a gestire le lunghe conversazioni, idealmente quelle superiori alle quindici domande. Per la società, lunghe sessioni di chat tendono a "confondere il modello di chat sottostante nel nuovo Bing". A seguito dei vari rapporti che di recente raccontano lo strano comportamento di Bing, il colosso americano ha spiegato la decisione di porre un limite al suo utilizzo che, raccontano dall'azienda, spesso "non è necessariamente utile o in linea con il motivo per cui è stato progettato". Man mano che le persone continueranno a chattare con l'IA, questa raffinerà tono e contesto degli argomenti, anche i più difficoltosi. Allora Microsoft potrà eliminare il blocco attuale ed espandere ulteriormente il servizio.