BRUXELLES - Vietati i sistemi per la sorveglianza generalizzata di massa ma permesso l'utilizzo,entro certe regole, della tecnologia del riconoscimento facciale: questa una delle principali novità della nuova proposta della Commissione europea per regolamentare l'utilizzo delle tecnologie ad intelligenza artificiale (AI) che verrà svelata dalla vicepresidente dell'esecutivo comunitario, Margrethe Vestager, il 21 aprile.

Secondo una bozza del documento, di cui l'ANSA ha presovisione, le aziende che non si conformeranno alle normepotrebbero ricevere multe fino a 20 milioni di euro o al 4% del loro fatturato. Tra le novità contenute nella proposta, anche l'attesa clausola del cosiddetto 'pulsante rosso' che prevede la

possibilità, attraverso l'intervento 'umano', di un arresto immediato della tecnologia in qualsiasi momento.

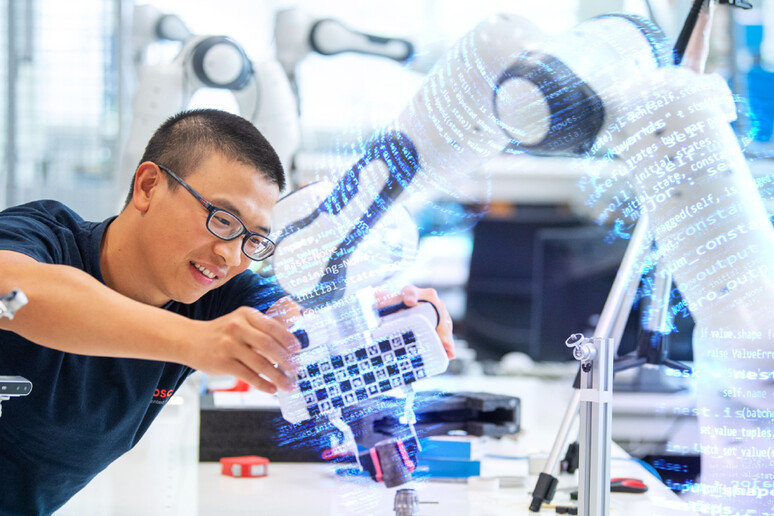

Bruxelles propone per la prima volta norme in materia e cerca così di recuperare il divario tecnologico con Cina e Stati Uniti creando le condizioni per lo sviluppo del settore dell'intelligenza artificiale fissando al contempo i paletti alle sue applicazioni. Un passo necessario alla creazione di un quadro giuridico chiaro per le imprese e comune a tutti gli Stati membri. I vantaggi economici promessi dalle possibili applicazioni della AI sono epocali ma anche i rischi non sono da sottovalutare. Prevenirli e gestirli è l'obiettivo della proposta dell'esecutivo.

Tra le novità in arrivo, la creazione di un elenco di tecnologie ad alto rischio, che comprende tutte le applicazioni ritenute, come si legge nel documento, "pericolose per l'integrità degli individui o per i diritti fondamentali". In questo campo, si incrina l'ipotesi di un divieto tout court per il controverso riconoscimento biometrico, voluto inizialmente da Vestager ma mai accettato completamente da alcuni Stati membri. Nella bozza di testo, si indica che l'uso di sistemi di questo tipo è previsto "per i governi e le autorità pubbliche dell'Ue" solo "se usato per salvaguardare la sicurezza pubblica". Ovvero per motivi come la lotta contro il terrorismo e la tutela dei cittadini. L'autorizzazione sarà data in ogni caso dopo una

rigida e attenta valutazione.

Vietati invece i sistemi di sorveglianza generalizzata della popolazione, le tecnologie che possono essere utilizzate per manipolare il comportamento, le opinioni o le decisioni dei cittadini. Saranno invece sottoposte a ulteriore controllo tutte le altre applicazioni ad alto rischio che servono a valutare un

punteggio sociale, la solvibilità creditizia delle persone o determinare l'accesso all'istruzione, e ancora i sistemi di reclutamento (scansione dei cv) o di valutazione delle richieste di asilo e visti. Restano escluse dal regolamento le applicazioni militari.

Meno regole infine per le tecnologie non considerate ad alto rischio per non disincentivare gli investimenti del settore privato: saranno ammessi tutte le applicazioni di AI che semplificano la produzione industriale o agricola, sostengono il cambiamento climatico oppure rendono la rete energetica più

efficiente.

Riproduzione riservata © Copyright ANSA