Potrebbe essere un video in cui un candidato viene ritratto in una situazione imbarazzante, ad esempio mentre fa sesso, oppure mentre insulta un avversario oltre il consentito. La tecnologia per preparare un 'deepfake', un video realizzato con l'intelligenza artificiale nel quale si fanno dire o fare a una persona cose che in realtà non ha detto e fatto è così avanti da poter scatenare uno scandalo politico, tanto che gli esperti stanno scommettendo sulla possibilità che questo avvenga prima delle prossime elezioni di midterm statunitensi, in novembre.

"Parliamo sempre di queste tecnologie e di come si possano simulare la voce di Obama o un video di Trump e mi sembra logico che ci sarebbero molti interessi nel vedere queste tecnologie al lavoro", ha detto alla rivista Ieee Spectrum il promotore della scommessa, Tim Hwang, che lavora nel Media Lab del Massachusetts Institute of Technology (Mit). "Mi chiedo solo - ha aggiunto - perchè non sia ancora successo". I deepfake stanno diventando sempre più famosi e diffusi negli ultimi mesi, dopo che sono apparse in rete numerose app per crearli. Ma la tecnologia sta andando ben oltre il semplice appiccicare, sia pure in maniera 'intelligente', il volto di una attrice a un video porno. Come dimostra un video realizzato dalla Stanford University, oltre a manipolare i volti ormai si è in grado di simulare la voce di una persona e le sue espressioni facciali, creando dei veri e propri 'manichini digitali'.

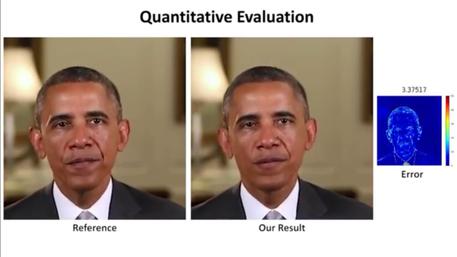

Questo si ottiene facendo lavorare in parallelo due intelligenze artificiali: una che fa il deepfake e l'altra che controlla che non ci siano errori. Per la scommessa vinceranno i sì se un video deepfake su un politico verrà condiviso almeno 2 milioni di volte prima che si capisca che è una bufala entro la fine del 2018. Hwang ha finora raccolto le puntate di 12 esperti e anche quelli che sono per il 'no' sono convinti che il problema si presenterà alle prossime presidenziali del 2020. In palio c'è un cocktail Manhattan. "La mia previsione è che entro il 2020 questa tecnologia sarà più diffusa e abbastanza economica da far sì che qualcuno la usi in questo modo. Al momento è ancora difficile", ha affermato uno dei sostenitor del 'no', Jack Clark della no profit 'OpenAi'. La minaccia è sicuramente presa sul serio dal Dipartimento della Difesa statunitense e la Darpa, il suo braccio scientifico, ha lanciato il Media Forensic Project per sviluppare un metodo per trovare automaticamente i deepfake.